预测模型是最常用的机器学习模型之一。梯度提升(Gradient Boosting)因其预测速度和准确性,特别是在处理大型复杂数据集时,表现尤为出色。从Kaggle竞赛到商业机器学习解决方案,这种算法都能产生最佳结果。它是一种提升方法,更广为人知的名称是梯度提升机(Gradient Boosting Machine,简称GBM),在本文中,我将讨论提升算法的含义、梯度提升算法的工作原理和实际案例应用。

提升(boosting)算法

“提升”(boosting)是数据科学领域中被误解最多的术语。提升算法背后的原理是:首先在训练数据集上建立一个模型,然后建立第二个模型来纠正第一个模型中的错误。

如图所示,假设我们有n个数据点,并且分类任务的输出类别为 0 和 1。目标是构建一个模型,用于预测测试数据的类别。首先,从训练数据集中随机选择一些样本,并将其输入到第一个模型 M1 中。假设起初所有样本的权重是相等的,即每个样本被选中的概率相同。

在集成学习中,多个弱学习器被组合起来形成一个强模型,因此 M1、M2、M3……Mn 都是弱学习器。由于 M1 是弱学习器,它会对部分样本进行错误分类。接下来,在将这些样本输入到模型 M2 之前,提升那些被错误分类样本的权重,同时降低被正确分类样本的权重。可以将这一过程类比为:一个袋子里最开始装有 10 个不同颜色的球,后来一个小孩拿出了他喜欢的颜色球,并放入了 4 个红色球,因此红色球被选中的概率自然会增加。

梯度提升(gradient boosting)算法

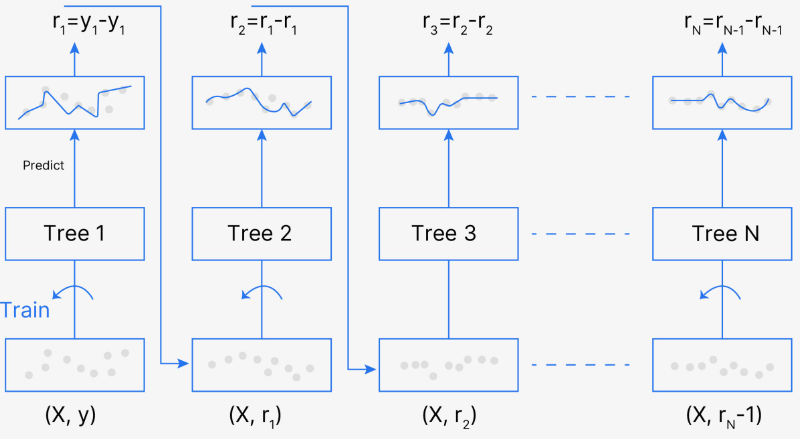

梯度提升(Gradient Boosting)是一种集成学习方法,它通过顺序地结合多个弱学习器(通常是决策树)来提升整体的预测性能。该方法的核心思想是根据前一轮迭代中的错误结果来调整模型权重,逐步减少预测误差,从而提高模型的准确率。对于连续目标值回归问题,使用梯度提升回归器(Gradient Boosting Regressor);而在分类任务中,则采用梯度提升分类器(Gradient Boosting Classifier)。两者的主要区别在于所使用的损失函数。每一轮中,当前的弱学习器是通过拟合前一轮模型损失函数的负梯度来构建的。如图所示,每个弱学习器都在拟合上一个模型的残差。

梯度提升的工作原理

梯度提升涉及三个要素:要优化的损失函数、做出预测的弱学习者、添加弱学习器以最小化损失函数的加法模型。

1、损失函数使用的损失函数取决于要解决的问题的类型。它必须是可微的,但支持许多标准损失函数,您可以定义自己的。例如,回归可能使用平方误差,分类可能使用对数损失。梯度提升框架的一个好处是不必为每个可能想要使用的损失函数派生新的提升算法,相反,它是一个足够通用的框架,可以使用任何可微分的损失函数。

2、弱学习者决策树被用作梯度提升中的弱学习器。具体来说,回归树用于输出分割的实际值,其输出可以相加,允许添加后续模型输出并“纠正”预测中的残差。树以贪婪的方式构建,根据Gini等纯度分数选择最佳分割点,或尽量减少损失。最初,例如在AdaBoost的情况下,使用了非常短的决策树,只有一个拆分,称为决策树桩。较大的树通常可以使用4到8级。通常以特定方式约束弱学习器,例如最大层数、节点数、分割数或叶节点数。这是为了确保学习者仍然很弱,但仍然可以以贪婪的方式构建。

3、加法模型一次添加一棵树,模型中的现有树不会更改。梯度下降过程用于最小化添加树时的损失。传统上,梯度下降用于最小化一组参数,例如回归方程中的系数或神经网络中的权重。在计算误差或损失后,更新权重以最小化该误差。我们有弱学习器子模型或更具体地说是决策树,而不是参数。计算完损失后,要执行梯度下降过程,我们必须在模型中添加一棵树以减少损失(即遵循梯度)。我们通过参数化树来做到这一点,然后修改树的参数并通过 (减少残差损失) 朝着正确的方向移动。通常这种方法称为函数梯度下降或函数梯度下降。

实际案例应用

李建伟等(2025)基于2011—2021年的沪深上市企业数据,采用轻量级梯度提升机算法(LightGBM)模型,选取均方误差MSE和决定系数R2两组算法检验指标进行迭代过程中的误差检验,以挖掘企业数字化转型的影响因素,并探究不同影响因素对企业数字化转型的特征重要性程度。研究结果发现:LightGBM模型的6次训练迭代均得到满意解,平均MSE 收敛仅为0.286,R2达0.685,说明所采用的算法具有较高鲁棒性与泛化性能;企业数字化转型受到内外部因素的双重影响,其中重点受到财政科技支出、税收优惠等外部因素的制约,第一大股东持股比例与管理层持股比例等内部因素影响较小;东部地区企业受内部因素的影响程度大于中西部地区企业;与服务业企业相比,制造业企业的数字化转型更容易受到外部因素的影响。

聂卉和吴晓燕(2024)通过收集“好大夫在线”平台上的抑郁症医疗咨询文本记录,构建了一个语料库。利用心理学词典,从中提取了患者的心理特征,并采用梯度提升树算法预测患者的病情,同时引入可解释机器学习方法SHAP解读模型,借助SHAP独特的可视化图表剖析患者年龄、性别、认知、情感、感知、社会家庭及个人得失与抑郁症发生之间的复杂关系。发现抑郁症患者心理状态能反馈患者病况,利用从患者问诊记录中提取的心理特征能够有效检测重度抑郁,准确率达到86%。可解释机器学习模型SHAP解释了模型的预测结果,揭示出患者各层面心理特征对抑郁症发生产生的多重效应。

Guan等(2025)构建了一个融合多源统计与遥感数据的县域碳排放估算与预测框架,系统评估了三种梯度提升算法(GBDT、XGBoost、LightGBM)在碳排放建模中的表现。结果表明,LightGBM在预测精度与计算效率之间取得了良好平衡,适用于大尺度、高分辨率的碳排放预测任务。

参考文献

[1] 李建伟,胡文艳,王薇. 企业数字化转型的影响因素及其贡献度——基于轻量级梯度提升机器(LightGBM)学习算法的研究[J]. 科技管理研究,2025,45 (09):64-73.

[2] 聂卉,吴晓燕. 结合梯度提升树算法与可解释机器学习模型SHAP的抑郁症影响因素研究[J]. 数据分析与知识发现,2024,8 (03):41-52.

[3] Guan D, Shi Y, Zhou L, Zhu X, Zhao D, Peng G, He X. Construction and Application of Carbon Emissions Estimation Model for China Based on Gradient Boosting Algorithm. Remote Sensing. 2025, 17(14): 2383.